ETL na Prática: 6 Casos de Uso com Estuary Flow

ETL na Prática: 6 Cenários Reais com Estuary Flow

No universo dos dados, uma constante permanece inabalável: a necessidade de construir pipelines de dados eficientes. Independentemente da nomenclatura (ETL, ELT ou outra), empresas dependem da movimentação e processamento de informações para gerar insights analíticos. A verdadeira questão reside em como essas pipelines são implementadas e quais ferramentas são realmente utilizadas no dia a dia.

A Essência dos Pipelines de Dados

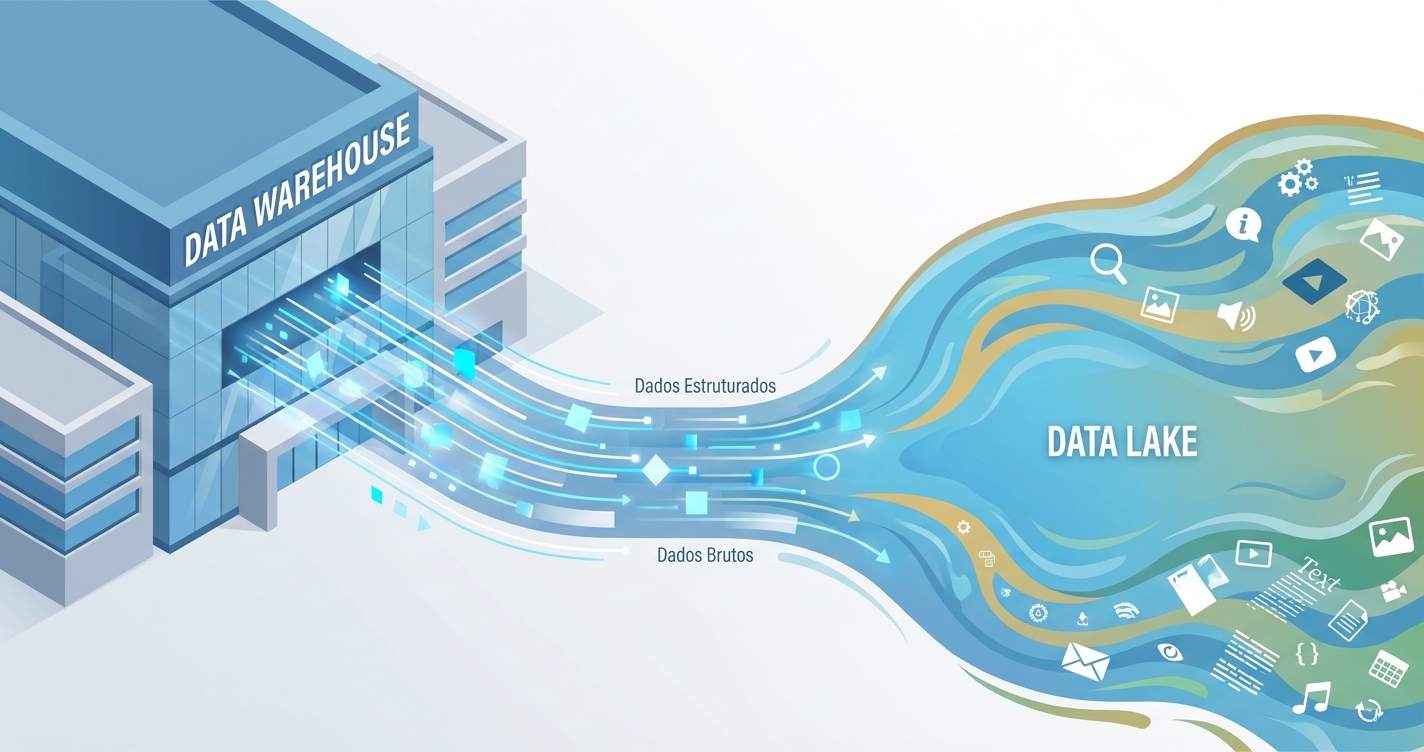

Para que a análise de dados seja eficaz, é fundamental que as informações estejam acessíveis, organizadas e prontas para serem consultadas. Isso envolve extrair dados de diversas fontes, transformá-los para um formato consistente e carregá-los em um destino final, como um data warehouse ou data lake. Esse processo, conhecido como ETL (Extract, Transform, Load), é a espinha dorsal de qualquer operação de Business Intelligence e Ciência de Dados.

A evolução tecnológica trouxe novas abordagens, como o ELT (Extract, Load, Transform), que adapta o fluxo para otimizar o uso de recursos em ambientes de nuvem. No entanto, o princípio de mover e preparar dados para análise permanece o mesmo, exigindo soluções robustas e flexíveis.

Estuary Flow: Uma Ferramenta para o Mundo Real

O Estuary Flow surge como uma solução projetada para simplificar a criação e o gerenciamento desses pipelines de dados. Ele se propõe a resolver desafios práticos enfrentados pelas equipes de dados, oferecendo uma abordagem mais ágil para a integração de informações.

Este artigo explora 6 casos de uso práticos onde a implementação de pipelines de ETL, utilizando o Estuary Flow, demonstra seu valor no mundo real. Cada cenário destaca como a ferramenta auxilia na superação de obstáculos comuns, permitindo que as empresas aproveitem melhor seus dados para tomadas de decisão mais assertivas.

Cenários em Foco:

- Integração de Múltiplas Fontes de Dados: Consolidação de dados de sistemas legados, APIs e bancos de dados diversos em um repositório centralizado para análise unificada.

- Streaming de Dados em Tempo Real: Criação de pipelines que capturam e processam fluxos contínuos de dados (ex: eventos de usuários, dados de sensores) para monitoramento e reações imediatas.

- Enriquecimento de Dados: Combinação de dados internos com fontes externas (ex: dados demográficos, informações de mercado) para gerar insights mais profundos.

- Migração de Dados para a Nuvem: Facilitação do processo de transferência de grandes volumes de dados para plataformas de nuvem, garantindo a integridade e a continuidade operacional.

- Preparação de Dados para Machine Learning: Criação de pipelines que limpam, transformam e formatam dados para alimentar modelos de aprendizado de máquina de forma eficiente.

- Orquestração de Fluxos Complexos: Gerenciamento de dependências e agendamentos para pipelines de dados com múltiplas etapas e processos interconectados.

Conclusão

A capacidade de construir e manter pipelines de dados robustos é um diferencial competitivo. O Estuary Flow apresenta-se como uma ferramenta que aborda as complexidades do ETL/ELT com foco na praticidade e na aplicabilidade em cenários reais. Ao entender como essas ferramentas funcionam em contextos práticos, as empresas podem otimizar suas estratégias de dados e extrair o máximo valor de suas informações.

Deixe um comentário